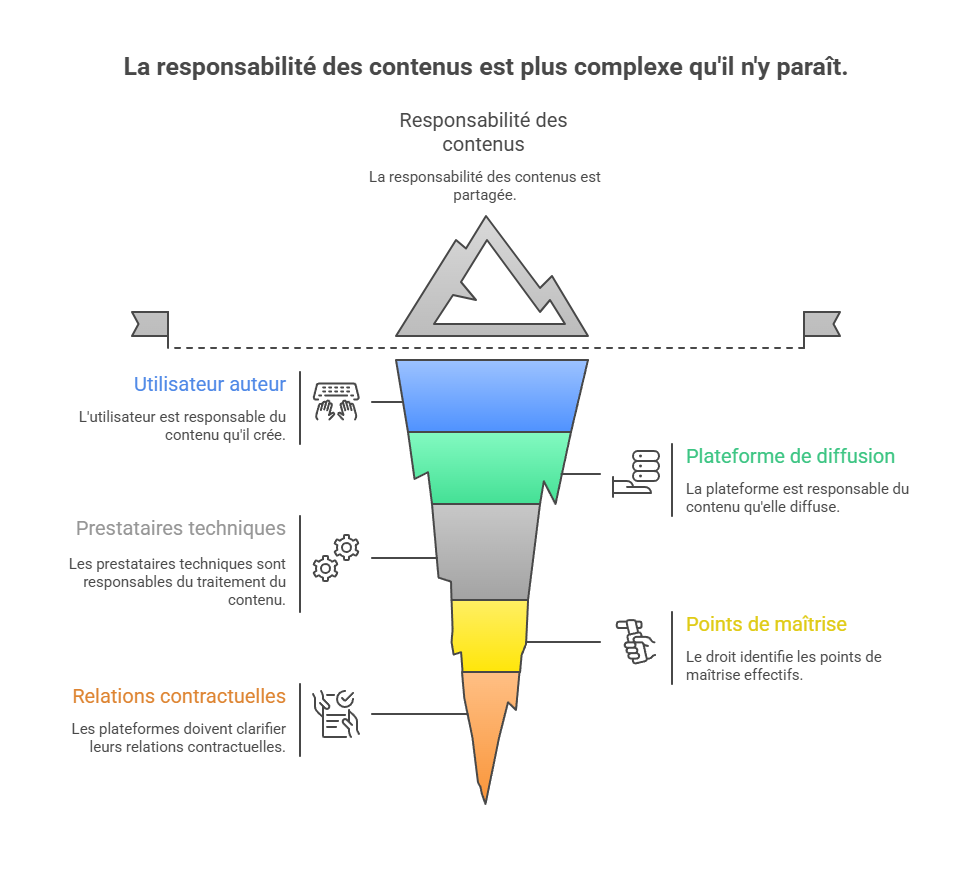

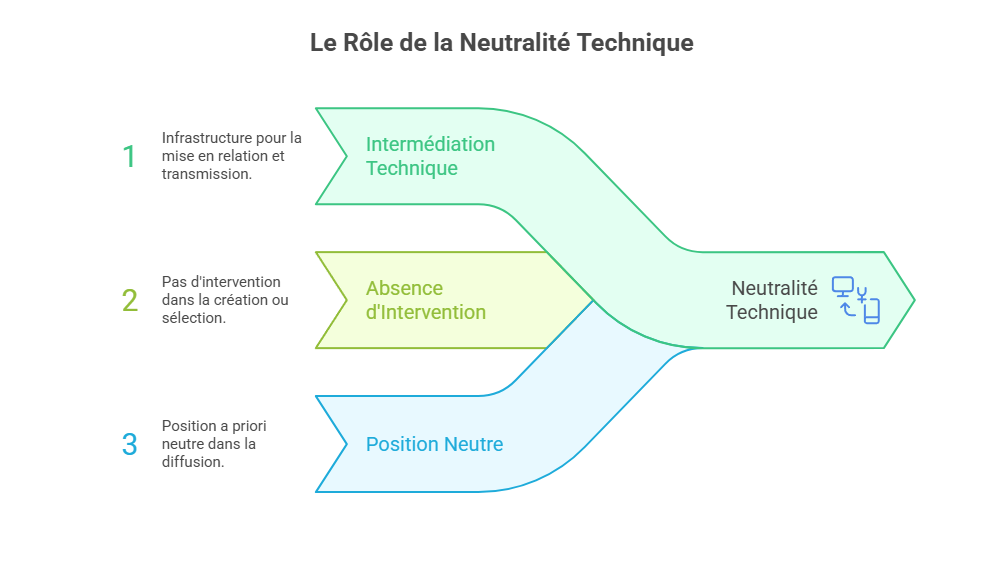

Les plateformes numériques sont qualifiées de services intermédiaires lorsqu'elles assurent une fonction d'intermédiation technique entre des utilisateurs, des contenus et des services, sans intervenir directement dans la création ou la sélection des contenus diffusés. Cette qualification repose sur l'idée que la plateforme fournit une infrastructure permettant la mise en relation, le stockage ou la transmission d'informations, tout en conservant une position a priori neutre. Cette neutralité fonctionnelle est déterminante, car elle conditionne l'application d'un régime de responsabilité allégé, historiquement fondé sur la distinction entre acteur technique et acteur éditorial.

La qualification de service intermédiaire repose sur la neutralité technique de la plateforme dans la diffusion des contenus.