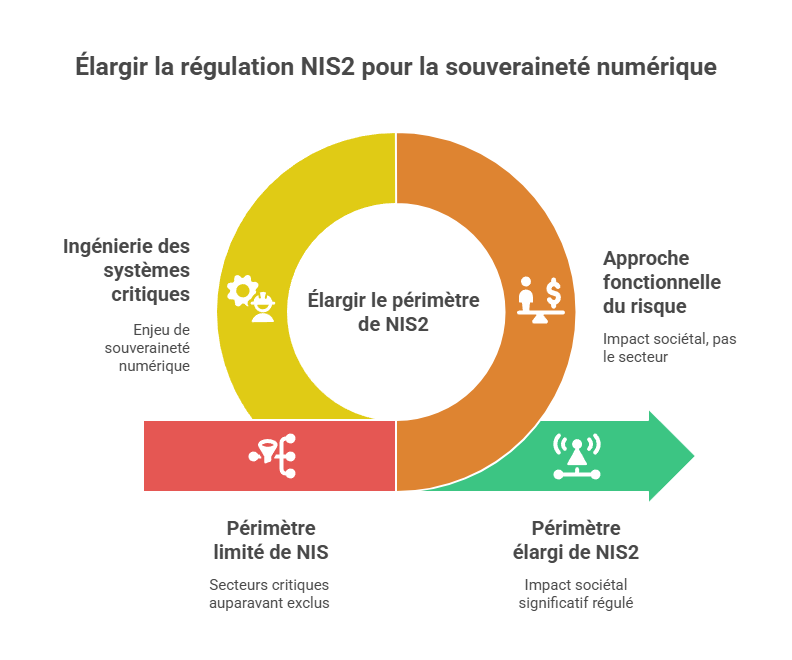

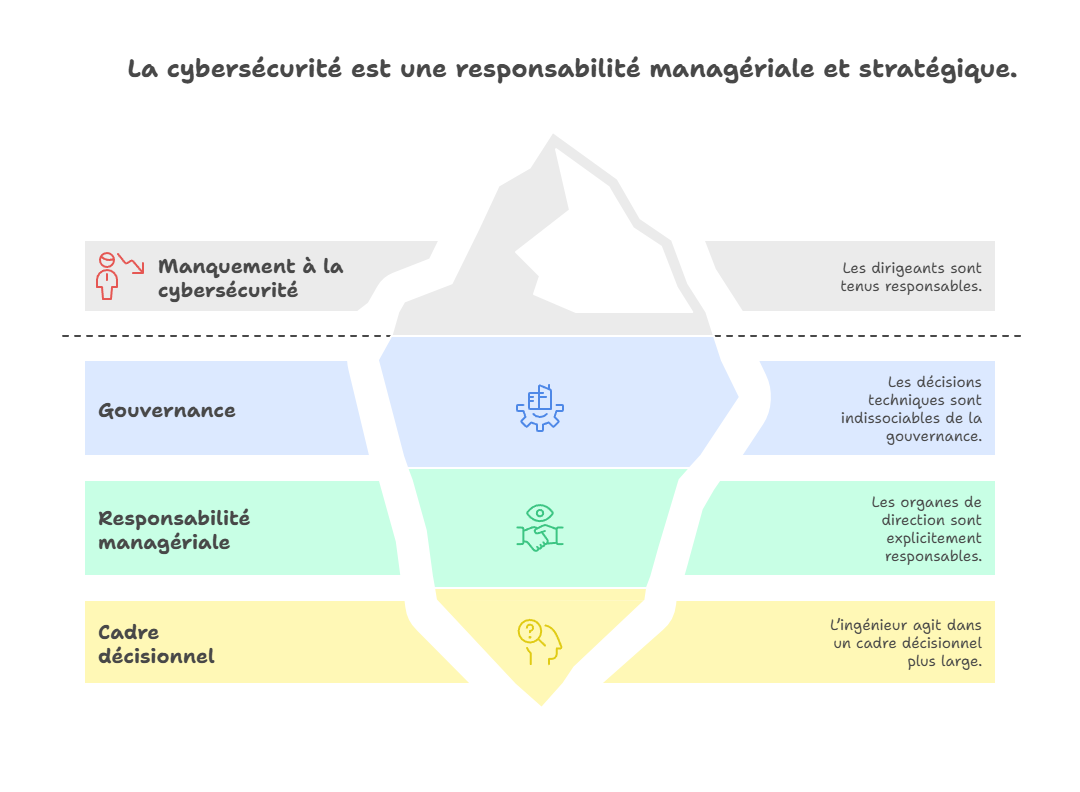

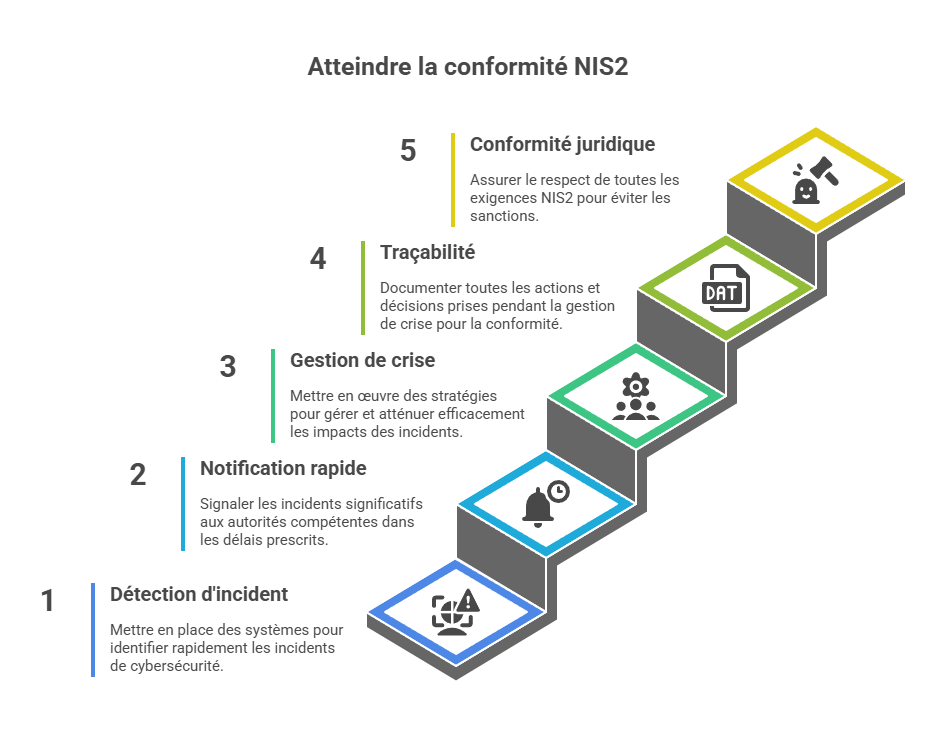

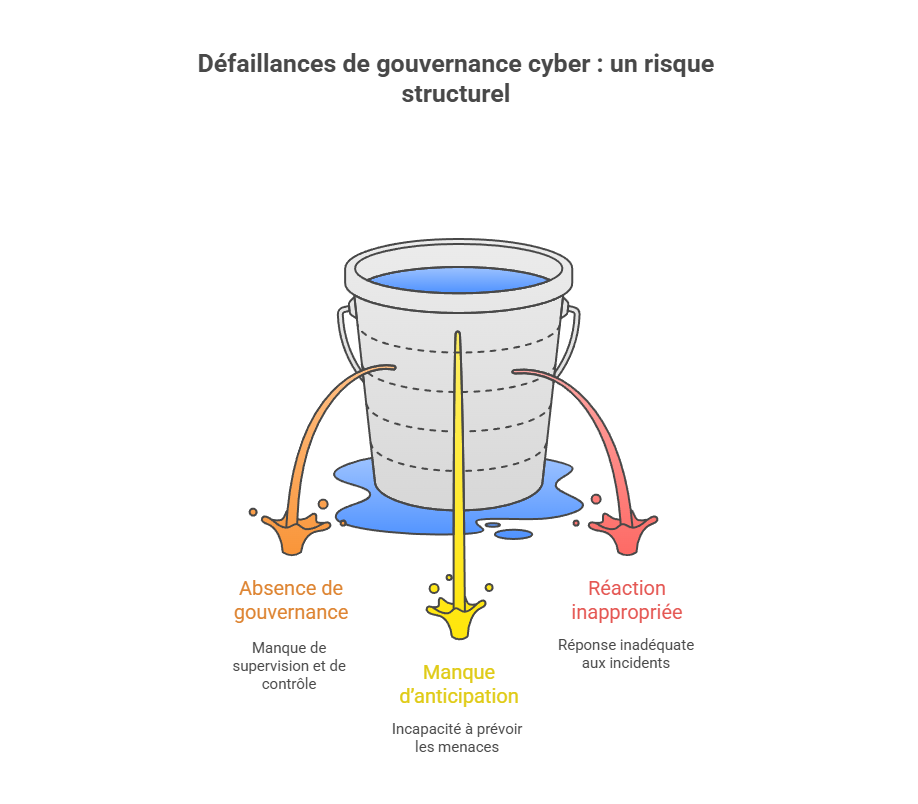

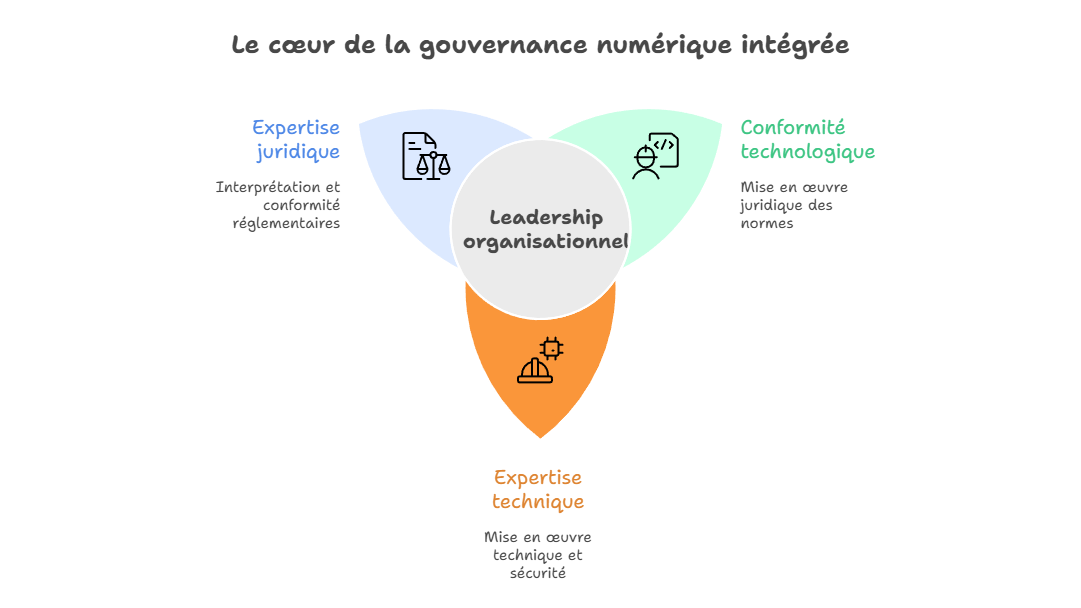

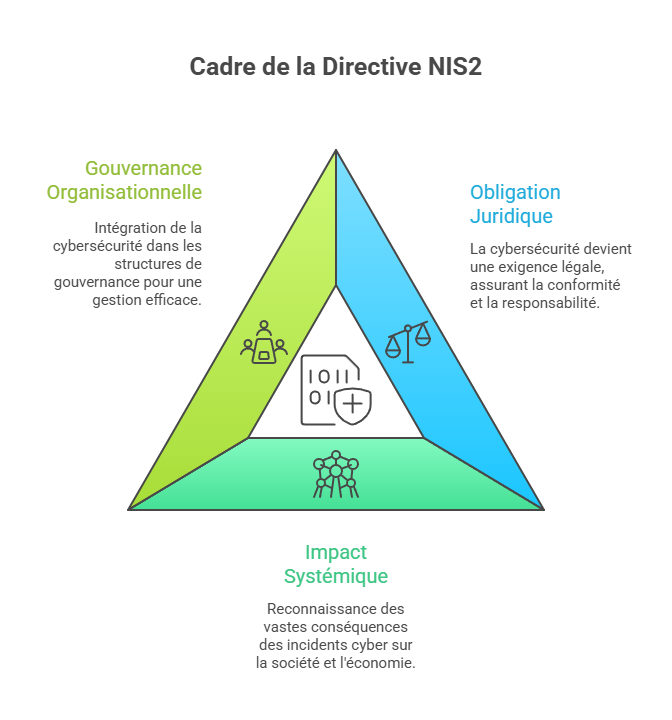

La directive NIS2 marque une rupture nette avec l'approche antérieure de la cybersécurité fondée sur les bonnes pratiques. Désormais, la sécurité des systèmes d'information devient une obligation juridique opposable, intégrée dans la gouvernance des organisations.

NIS2 transforme la cybersécurité d'une recommandation technique en une obligation juridique structurante.