GROUPE 1 — Notation académique automatisée et blockchain universitaire

Une université internationale utilise un système blockchain pour enregistrer les copies, stocker les résultats et déclencher automatiquement l'attribution des diplômes.

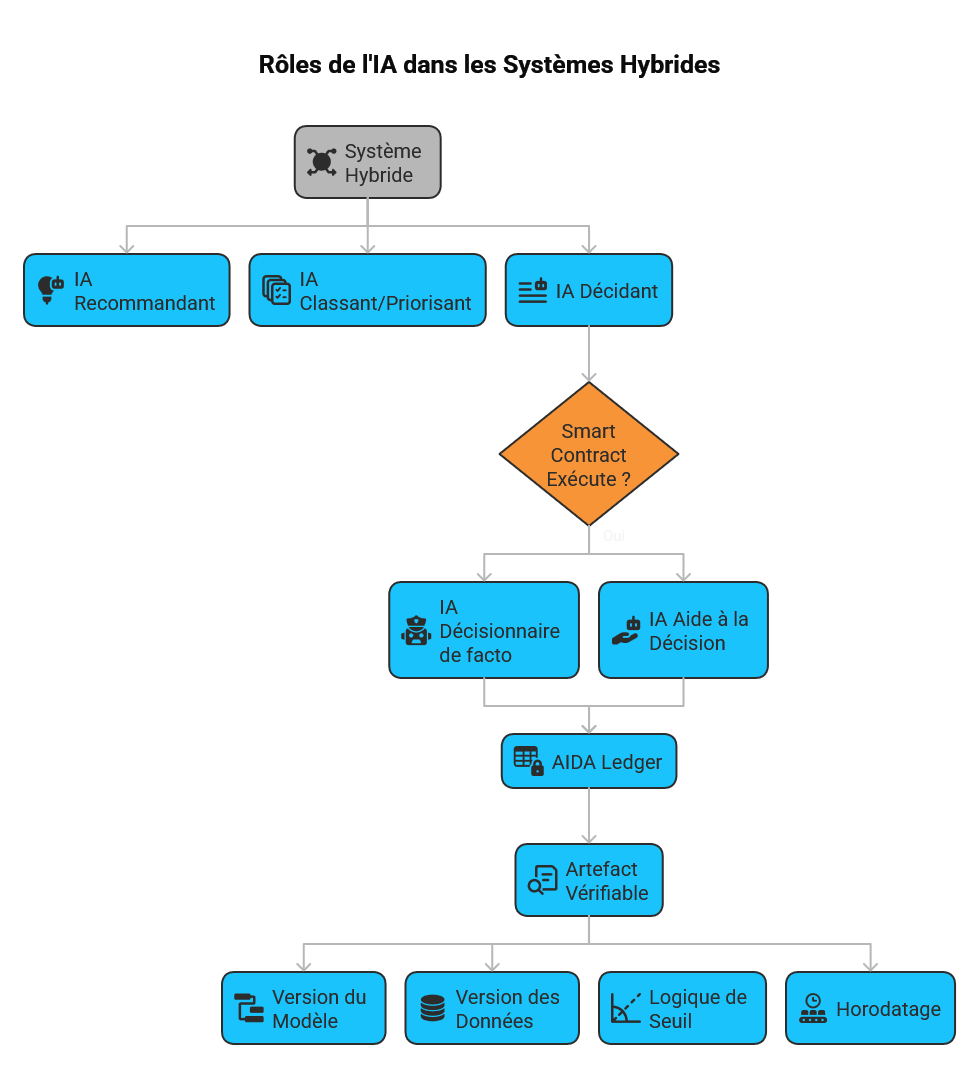

Une IA corrige certaines épreuves et déclenche validation, rattrapage ou exclusion.

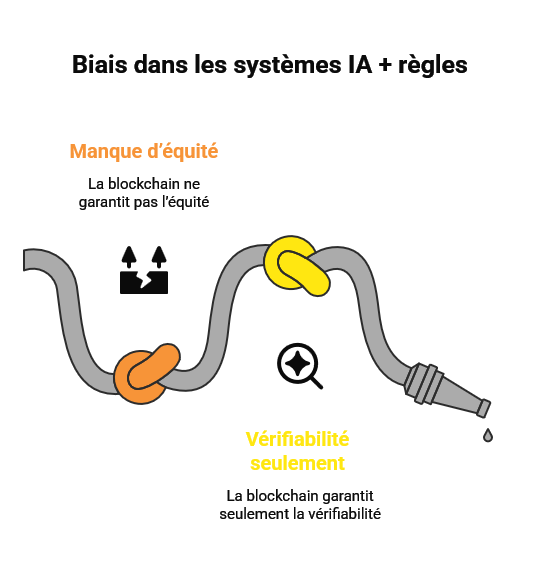

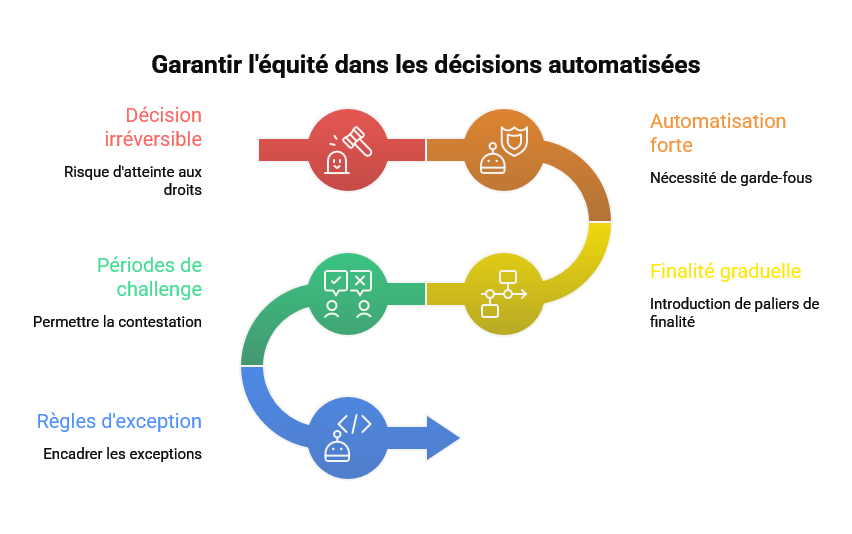

Problème : Une erreur de notation entraîne l'exclusion automatique d'un étudiant.

GROUPE 2 — Assurance agricole paramétrique et IA climatique

Une assurance verse automatiquement des indemnisations agricoles via smart contract, sur la base de données climatiques et d'un modèle IA évaluant la sécheresse.

Problème : Une région est exclue des indemnisations à cause d'un modèle mal calibré.

GROUPE 3 — Gestion algorithmique du travail sur plateforme logistique

Une plateforme utilise une IA de performance et une blockchain pour tracer horaires, tâches et sanctions. Les sanctions (baisse de missions, exclusion) sont automatiques.

Problème : Un travailleur est exclu sans recours humain.

GROUPE 4 — Attribution de subventions culturelles par DAO

Une DAO culturelle distribue des fonds publics via vote on-chain et IA de présélection des projets.

Problème : Un projet est écarté pour "faible score", sans justification claire.

GROUPE 5 — Accès à l'eau en zone de stress hydrique

Une collectivité utilise capteurs IoT, IA de prévision et blockchain pour rationner automatiquement l'eau.

Problème : Un quartier est pénalisé à tort.

Travail demandé

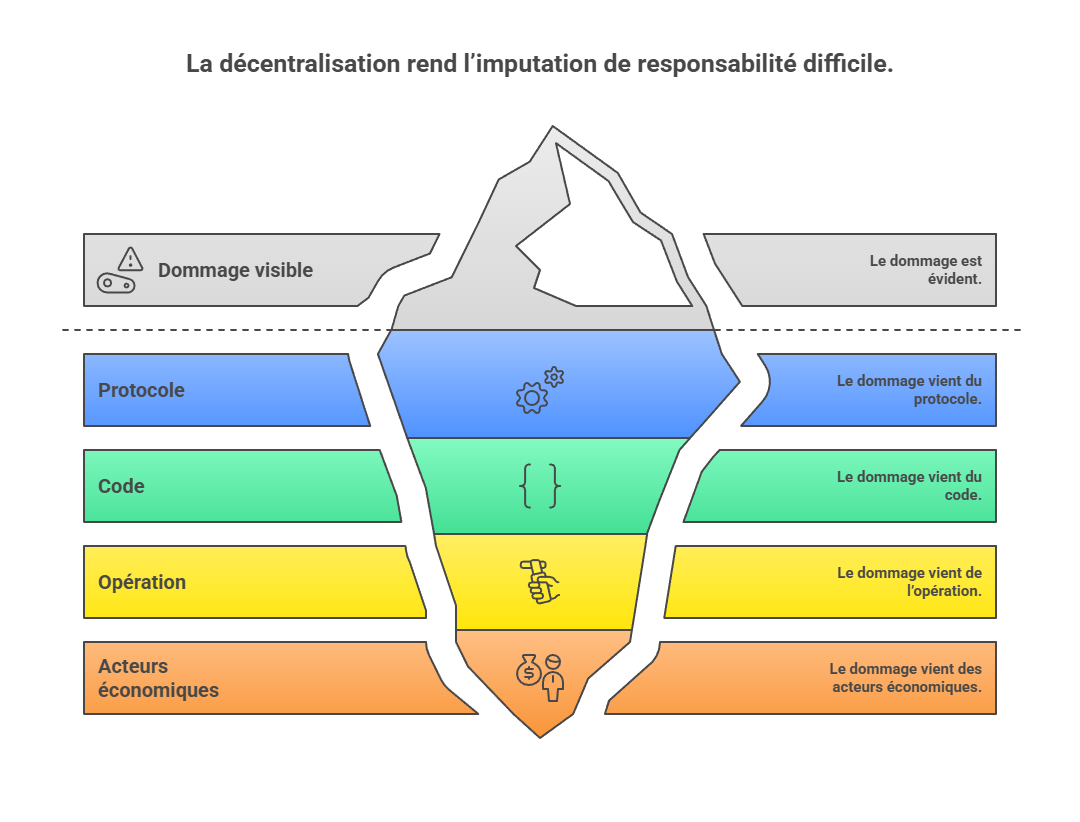

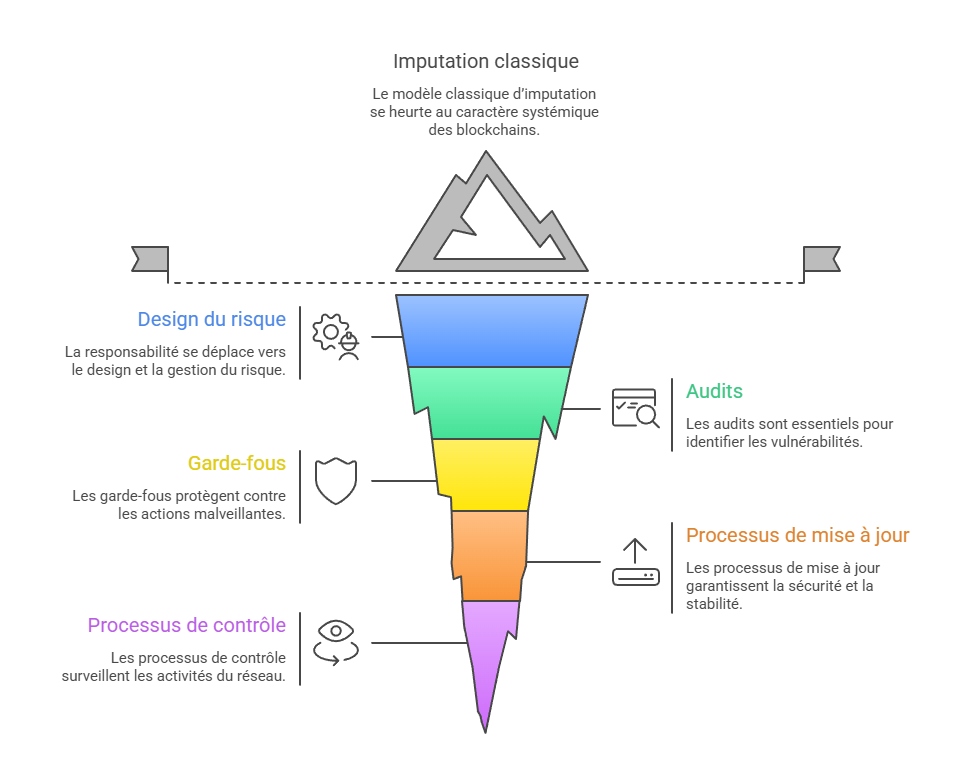

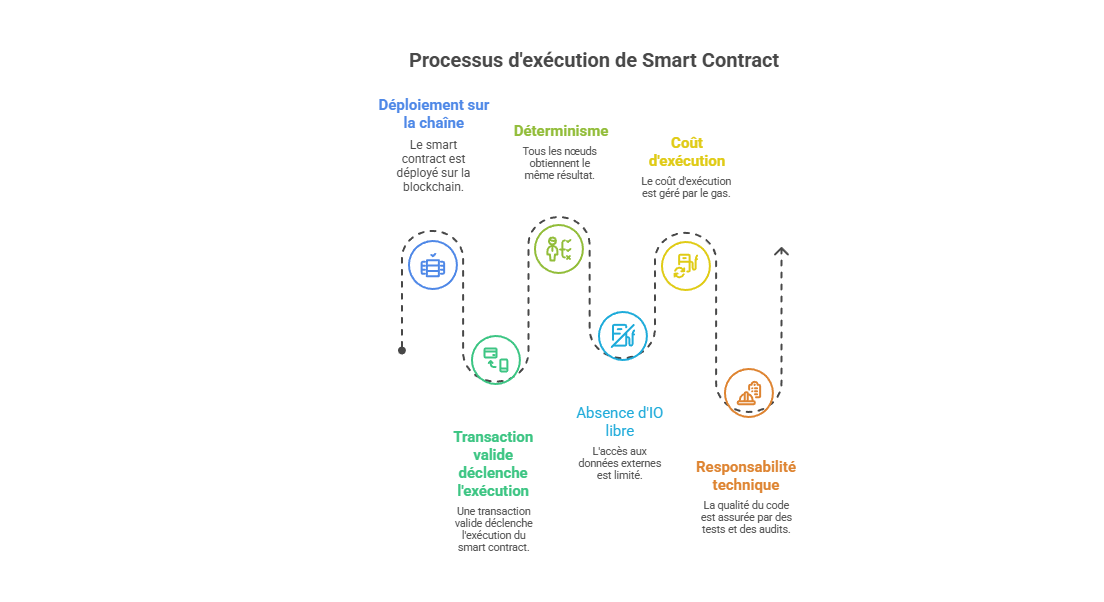

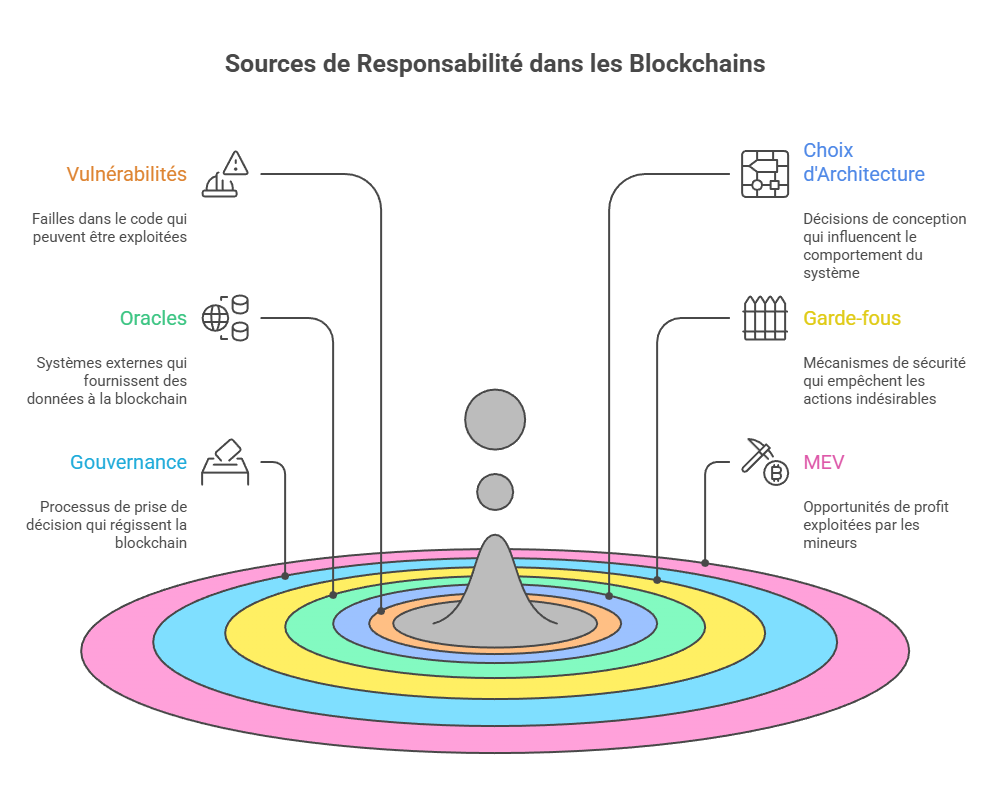

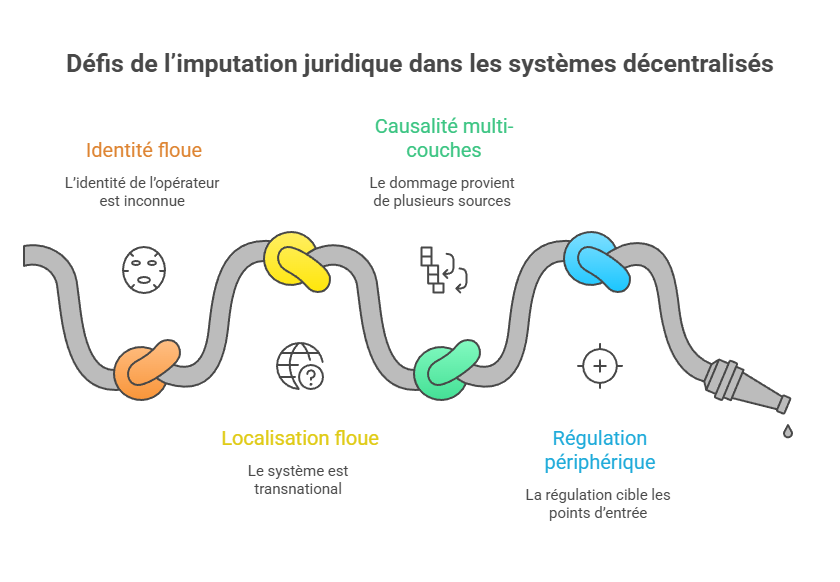

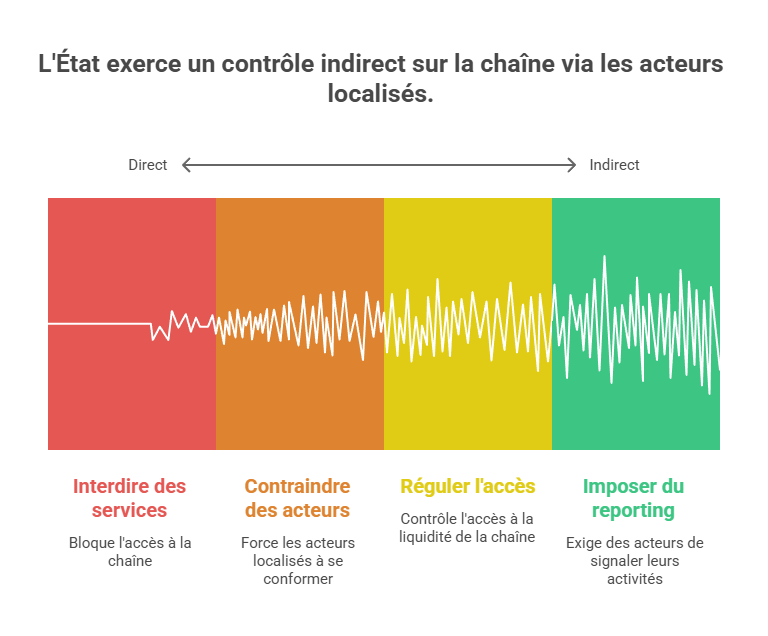

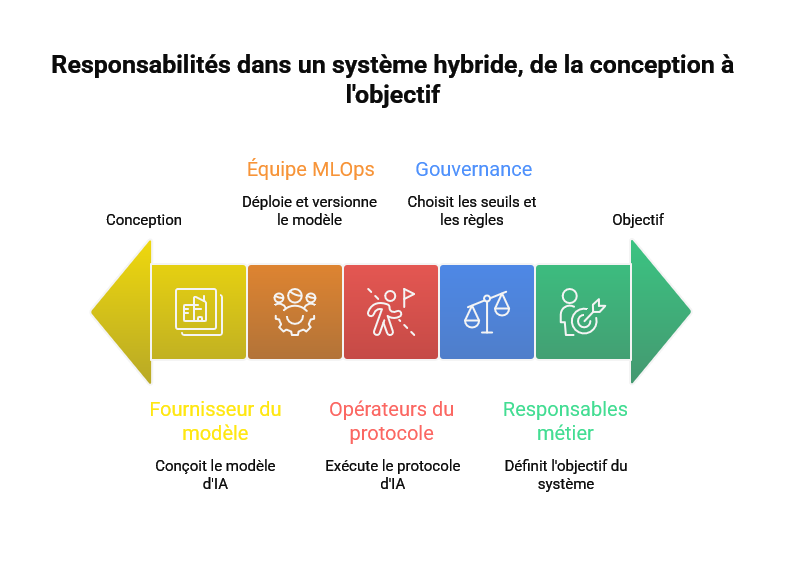

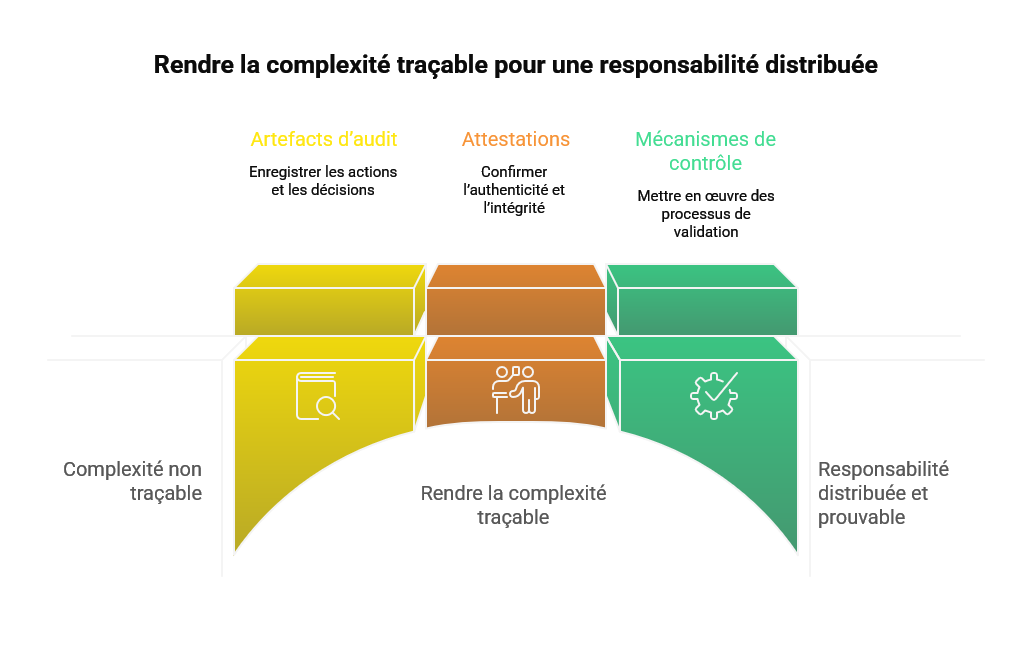

- 1. Identifier tous les acteurs techniques et humains impliqués (développeurs, opérateurs, utilisateurs, validateurs, autorités, IA).

- 2. Décrire le fonctionnement du système (flux, automatisation, décisions).

- 3. Localiser les zones de dilution de responsabilité : qui agit, qui décide, qui subit.

- 4. Identifier un scénario de dommage plausible.